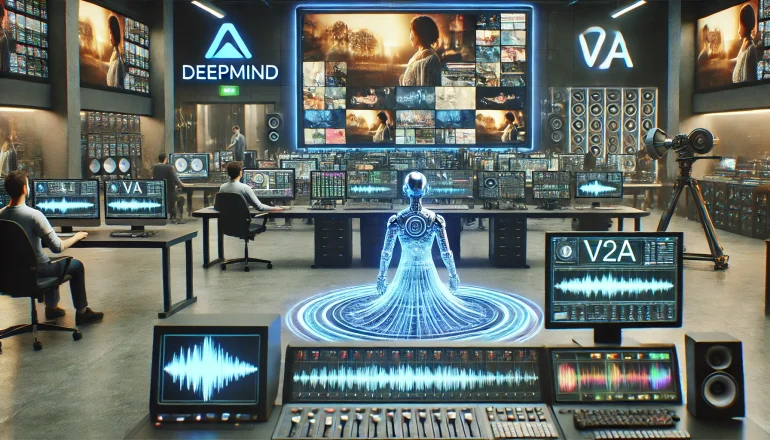

DeepMind rozwija technologię AI do generowania dźwięku

DeepMind, laboratorium badawcze Google zajmujące się sztuczną inteligencją, opracowuje technologię AI do generowania ścieżek dźwiękowych do wideo. Technologia ta, nazwana V2A (skrót od „video-to-audio”), jest kluczowym elementem w tworzeniu mediów generowanych przez AI. W przeciwieństwie do wielu obecnych systemów generowania wideo, V2A może tworzyć efekty dźwiękowe, które synchronizują się z generowanymi obrazami.

Jak działa technologia V2A?

Technologia V2A wykorzystuje opis ścieżki dźwiękowej (np. „meduzy pulsujące pod wodą, życie morskie, ocean”) powiązany z wideo, aby stworzyć muzykę, efekty dźwiękowe i dialogi dopasowane do postaci i tonu filmu. Model AI stojący za V2A, model dyfuzji, był trenowany na kombinacji dźwięków, transkryptów dialogów i klipów wideo.

Uczenie się przez technologię V2A

DeepMind wyjaśnia, że technologia ta uczy się kojarzyć konkretne zdarzenia dźwiękowe z różnymi scenami wizualnymi, reagując na informacje zawarte w adnotacjach lub transkryptach. Istotnym elementem jest również technologia SynthID, która pomaga walczyć z deepfake’ami, oznaczając generowane treści odpowiednimi znakami wodnymi.

Kwestie praw autorskich i dane treningowe

Nie jest jasne, czy dane treningowe pochodziły z materiałów chronionych prawami autorskimi i czy ich twórcy byli poinformowani o pracach DeepMind. Firma nie udzieliła jeszcze odpowiedzi na ten temat.

Inne narzędzia do generowania dźwięku zasilane AI

Narzędzia do generowania dźwięku zasilane AI nie są nowością. Niedawno startup Stability AI wypuścił takie narzędzie, a ElevenLabs uruchomiło swoje w maju. Istnieją również modele do tworzenia efektów dźwiękowych do wideo. Na przykład projekt Microsoftu potrafi generować mówiące i śpiewające wideo z jednego obrazu, a platformy takie jak Pika i GenreX mają modele, które potrafią dobrać odpowiednią muzykę lub efekty do określonej sceny.

Unikalność technologii V2A

DeepMind twierdzi jednak, że jego technologia V2A jest unikalna, ponieważ potrafi zrozumieć surowe piksele z wideo i automatycznie synchronizować generowane dźwięki z wideo, nawet bez opisu.

Ograniczenia technologii V2A

Mimo swoich możliwości, V2A nie jest idealna. DeepMind przyznaje, że model nie był trenowany na dużej liczbie wideo z artefaktami lub zniekształceniami, co skutkuje niższą jakością dźwięku w takich przypadkach. Ogólnie rzecz biorąc, generowane dźwięki nie są jeszcze przekonujące.

Dalszy rozwój i testy bezpieczeństwa

Aby zapobiec niewłaściwemu wykorzystaniu, DeepMind nie planuje udostępniać technologii V2A publicznie w najbliższym czasie, jeśli w ogóle. Firma zbiera obecnie opinie i perspektywy od wiodących twórców i filmowców, które mają pomóc w dalszym rozwoju i ocenie bezpieczeństwa technologii.

Potencjalne zastosowania technologii V2A

DeepMind widzi swoją technologię jako szczególnie użyteczną dla archiwistów i osób pracujących z historycznymi materiałami filmowymi. Jednak rozwój AI tego typu może również wpłynąć na przemysł filmowy i telewizyjny, stwarzając ryzyko dla miejsc pracy. Konieczne będą silne zabezpieczenia praw pracowniczych, aby generowane przez AI narzędzia nie eliminowały zawodów.